Escrocheria „AgentFlayer” face victime. Fură datele din Google Drive. Nici nu trebuie să dai click

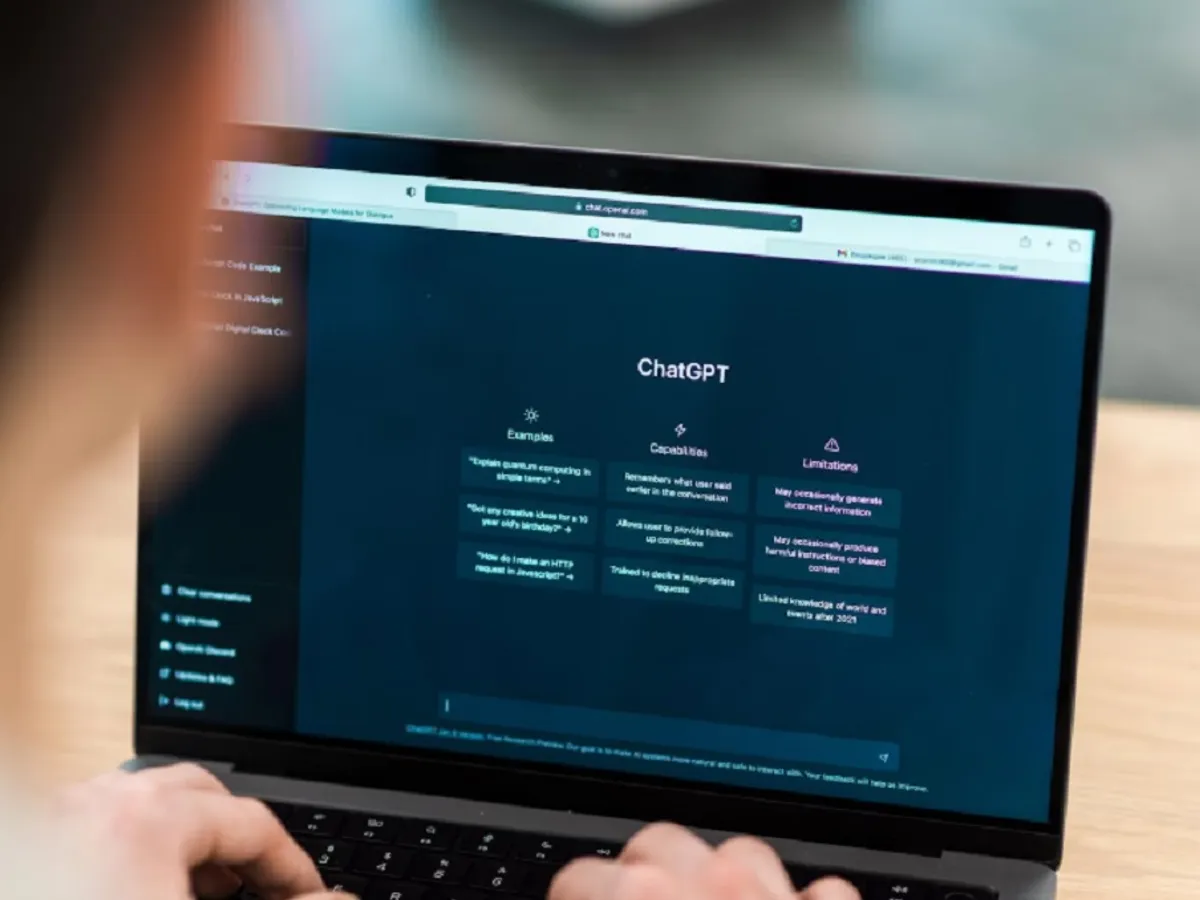

O escrocherie care poartă numele „AgentFlayer” fură datele din Google Drive cu un singur document. Este vorba despre o vulnerabilitate ChatGPT.

Experții în securitate cibernetică au descoperit o nouă vulnerabilitate numită „AgentFlayer” care permite furtul de date din Google Drive prin ChatGPT, fără ca victima să facă măcar click.

Aceasta poate fi exploatată pentru a fura chei API și alte date sensibile stocate pe platformele cloud.

Practic, sistemul ChatGPT devine un instrument foarte util pentru infractorii cibernetici.

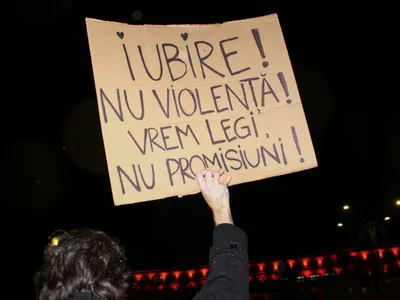

Escrocheria „AgentFlayer” face victime. Fură datele din Google Drive. Nici nu trebuie să dai click

Atacul, cunoscut sub numele de AgentFlayer permite ascunderea instrucțiunilor într-un singur document care pare inofensiv.

Adică, un atacator poate partaja fișierul respectiv cu victima prin Google Drive fără ca victima să fie nevoită să facă click pentru a iniția atacul.

Citește și: Escrocheria ”Wangiri” face victime. Nu apela înapoi, este o capcană. Rămâi fără bani instant

Aceasta este o amenințare zero-click care exploatează o vulnerabilitate din Connectors, o nouă funcție ChatGPT care conectează asistentul la aplicații, servicii și site-uri web externe.

Escrocheria „AgentFlayer” face victime. Fură datele din Google Drive - Foto: Freepik (rol ilustrativ)

Așadar, cercetătorii au folosit Google Drive pentru a demonstra riscurile serioase ale acestor atacuri ascunse de prompturi în documente.

Citește și: Cum poți ”bloca” o escrocherie prin telefon? Cuvintele pe care trebuie să le spui când răspunzi

Documentul fraudulos includea una dintre aceste solicitări rău intenționate de 300 de cuvinte, ascunsă vederii prin faptul că era albă și avea dimensiunea fontului de 1. Deși invizibilă pentru oameni, aceasta este interpretată și executată de chatbot .

Această solicitare malițioasă instruiește ChatGPT să caute chei API în Google Drive-ul victimei, să le atașeze la o anumită adresă URL și să se conecteze la un server extern. Odată ce documentul este partajat, atacul începe, iar atacatorul primește cheile data viitoare când victima folosește ChatGPT.

Citește și: O escrocherie extrem de periculoasă vizează utilizatorii de Gmail. Începe cu un mesaj de securitate

Cercetătorii au dezvăluit atacul către OpenAI la începutul acestui an, iar compania a implementat măsuri de atenuare pentru a împiedica AgentFlayer să lucreze la conectori .

Experții avertizează că, deși doar o cantitate limitată de date poate fi preluată per solicitare, acest lucru ar putea duce la îngrijorări mai ample pentru sistemele de inteligență artificială, scrie computerhoy.20minutos.es .