Monitorul dezinformării. Atunci când narațiunile false devin profitabile

Noul program de partajare a anunțurilor X le permite celor care răspândesc informații în postări care devin virale să împartă veniturile din publicitate de la marile branduri.

Pe X, fostul Twitter, reclame programatice pentru zeci de mărci importante, guverne, instituții educaționale și organizații non-profit sunt afișate în fluxuri direct sub postările virale care avansează afirmații false sau înșelătoare despre războiul dintre Israel și Hamas, a constatat o analiză NewsGuard.

Monitorul dezinformării. Atunci când narațiunile false devin profitabile

În conformitate cu termenii unui nou program de partajare a veniturilor din publicitate pe care X l-a introdus pentru „creatorii“ săi, o parte din veniturile din publicitate generate de aceste organizații ar fi aparent împărțite cu acești superexpeditori de dezinformare.

În perioada 13 noiembrie - 22 noiembrie 2023, analiștii NewsGuard au analizat reclamele programatice care au apărut în fluxurile de sub

30 de tweet-uri virale care conțineau informații false sau extrem de înșelătoare despre război.

Anunțurile programatice sunt servite prin intermediul unor algoritmi pentru a le către cititorii online. De obicei, mărcile nu selectează locul de difuzare a anunțurilor programatice și, într-adevăr, nu știu unde apar acestea.

Aceste 30 de tweet-uri virale au fost postate de zece dintre cei mai mari furnizori de dezinformări legate de războiul dintre Israel și Hamas din X și au ajuns, în mod cumulat, la o audiență de peste 92 de milioane de telespectatori, conform datelor X. În medie, fiecare tweet a fost văzut de 3 milioane de persoane. Conturile analizate de NewsGuard fuseseră identificate anterior ca răspândind repetat dezinformări cu privire la conflict.

Unii dintre cei mai mari furnizori

de dezinformare legată de

război din X ar fi fost probabil

îndreptățiți să primească

venituri din publicitate de la

organizații importante

Cele 30 de tweet-uri au avansat unele dintre cele mai grave afirmații false sau înșelătoare despre război. Printre acestea se numără faptul că atacul Hamas din 7 octombrie împotriva Israelului a fost sub „steag fals“ și că CNN a înscenat imagini cu un atac cu rachete din octombrie 2023 asupra unei echipe de știri din Israel.

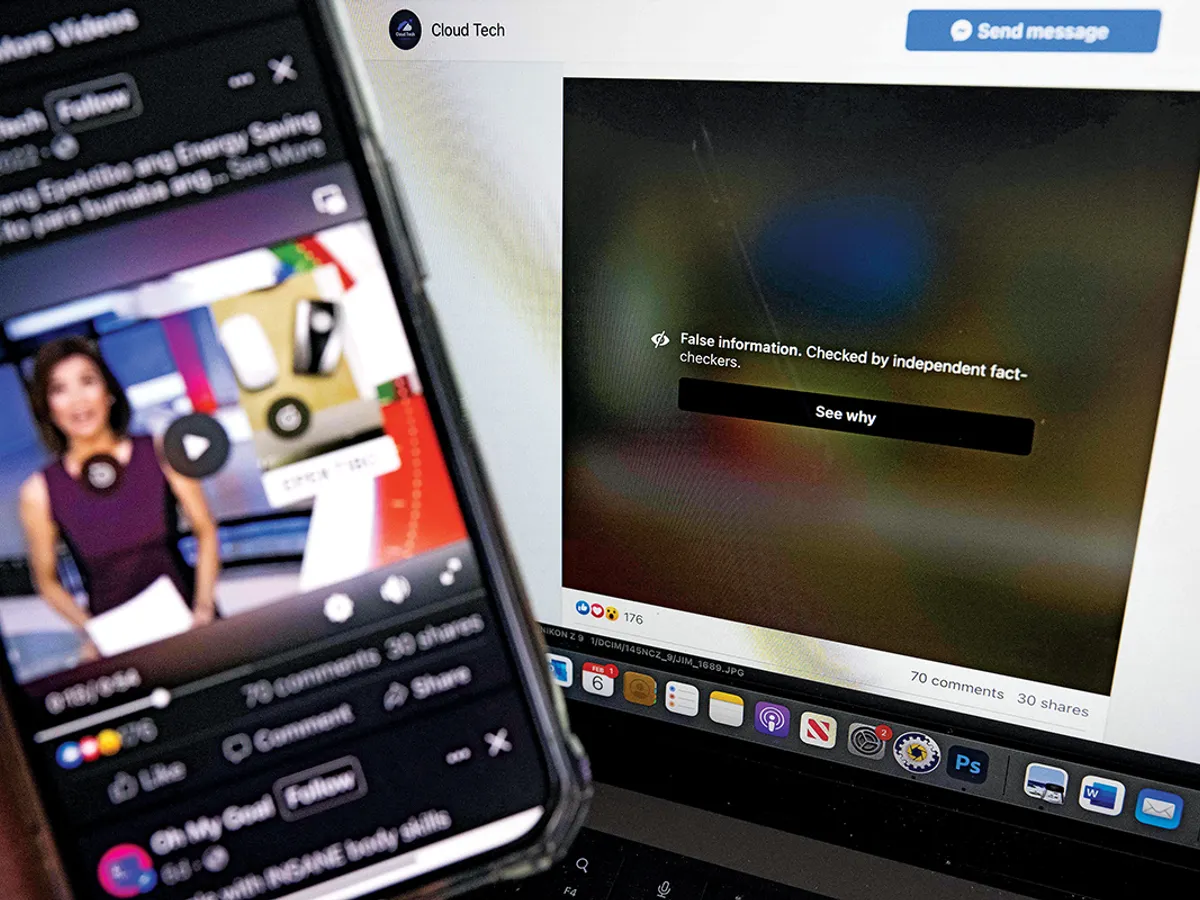

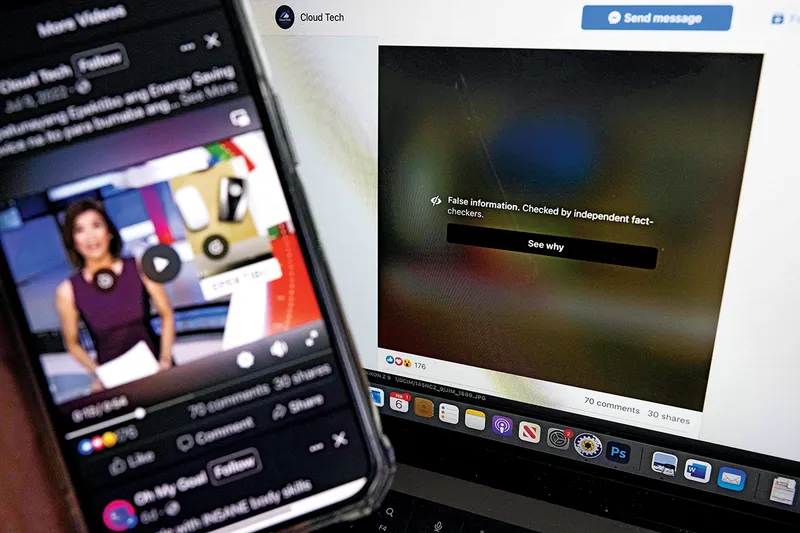

Jumătate dintre tweet-uri (15) au fost marcate cu o verificare a faptelor de către Community Notes (caracteristica de verificare a faptelor din partea comunității de la X), ceea ce, conform politicii companiei, le-ar fi făcut neeligibile pentru venituri din publicitate.

Cu toate acestea, cealaltă jumătate nu a fost însoțită de Community Notes. NewsGuard a găsit reclame pentru mărci importante precum Pizza Hut, Airbnb, Microsoft, Paramount și Oracle în postări cu și fără Community Notes, după cum se explică în detaliu mai jos.

În total, analiștii NewsGuard au identificat 200 de reclame de la 86 de mărci importante, organizații non-profit, instituții educaționale și guverne care au apărut în fluxurile de sub 24 dintre cele 30 de tweet-uri care conțineau afirmații false sau extrem de înșelătoare despre războiul dintre Israel și Hamas. Celelalte șase tweet-uri nu conțineau reclame. (Pe X, reclamele apar sub formă de „tweet-uri“ care sunt afișate utilizatorilor în fluxuri.) Reclamele pe care News-Guard le-a găsit au fost servite analiștilor care navigau pe internet folosind propriile conturi X în cinci țări: SUA, Marea Britanie, Germania, Franța și Italia.

Raportul NewsGuard vine după ce Apple, Disney și IBM și-au retras reclamele de pe X după ce proprietarul Elon Musk a vorbit în mod aprobator despre o postare antisemită pe platformă. Ca răspuns la întrebările trimise prin e-mail de NewsGuard cu privire la constatările organizației și la reclamele care apar în fluxurile de sub tweet-urile care avansează dezinformări, biroul de presă al X a trimis un răspuns automat: „Ocupat acum, vă rugăm să reveniți mai târziu“.

Pe 21 noiembrie, după ce News-Guard a contactat X în legătură cu acest raport, Musk a scris pe Twitter: „X Corp va dona toate veniturile din publicitate și abonamente asociate cu războiul din Gaza spitalelor din Israel și CruciiRoșii/Crescent din Gaza“.

Nu este clar ce a vrut să spună Musk prin „veniturile din publicitate și abonamente asociate cu războiul din Gaza“ și nici nu a comentat cu privire la faptul că mulți sau toți acești deținători de conturi vor împărți veniturile X pentru răspândirea de dezinformări. Ca răspuns la solicitarea NewsGuard din 22 noiembrie prin care se cereau clarificări cu privire la anunțul lui Musk, biroul de presă al X a răspuns din nou cu un răspuns automat.

Monetizarea subiectului despre „bebelușul ars“

Pe 29 octombrie, proprietarul X, Elon Musk, a declarat că acei comentatori ale căror postări au fost semnalate de Community Notes nu vor fi eligibili pentru a câștiga bani din reclame pe postul respectiv.

Cu toate acestea, NewsGuard a găsit reclame pentru 70 de organizații majore pe 14 dintre cele 15 tweet-uri care promovau dezinformări legate de război și care nu prezentau o verificare a faptelor de către Community Notes.

Acest lucru înseamnă că unii dintre cei mai răi furnizori de dezinformare legată de război de pe X ar fi avut probabil dreptul să primească bani pentru publicitate de la organizații importante.

De exemplu, NewsGuard a găsit 22 de reclame pentru organizații importante pe trei tweet-uri postate de Jackson Hinkle, în care se făceau afirmații false despre război și care nu prezentau o așa numită Notă comunitară. Hinkle este un comentator care se descrie ca fiind un „marxist-leninist conservator american“ și a răspândit zeci de afirmații false și înșelătoare despre război, a stabilit NewsGuard.

Anunțuri pentru Oracle, Pizza Hut și Anker, printre altele, au fost prezentate analiștilor NewsGuard sub un tweet postat de Hinkle în luna octombrie. Tweetul său a avansat afirmația falsă conform căreia gazda podcastului Daily Wire, Ben Shapiro, a folosit inteligența artificială pentru a genera o imagine a unui copil ucis de Hamas.

Tweetul a primit 22 de milioane de vizualizări până pe 20 noiembrie 2023. Din nou, este un fapt evident al publicității programatice faptul că brandurile nu sunt conștiente de locul în care apar reclamele lor și pe cine susțin acestea.

Tweeturile virale au fost

postate de zece dintre

cei mai mari furnizori de

dezinformare legată de

războiul dintre Israel și Hamas

de pe X și au ajuns cumulat

la o audiență de peste 92 de

milioane de spectatori

„Sfinte Sisoe“, a spus Hinkle. „Imaginea pe care Ben Shapiro a încercat să o facă să treacă drept un «cadavru de bebeluș ars» era o imagine falsă generată de AI!“.

De fapt, nu există nicio dovadă că fotografia - care a fost împărtășită pentru prima dată de guvernul israelian - a fost generată cu ajutorul AI. Hany Farid, profesor la Școala de Informații a Universității din Berkeley, a declarat pentru site-ul de știri tehnologice 404 Media că imaginea bebelușului „nu prezintă niciun semn că a fost creată de AI“.

El a spus: „Consistența structurală, umbrele precise, lipsa artefactelor pe care tindem să le vedem în AI - asta mă face să cred că nu este nici măcar parțial generată de AI“.

În mod similar, reclame pentru Airbnb, Virgin Group, compania taiwaneză de tehnologie Asus, compania media conservatoare The Dispatch și compania suedeză de igienă Essity, care valorează mai multe miliarde de dolari, au apărut alături de o postare a comentatorului conservator Matt Wallace, care a afirmat în mod nefondat că atacul Hamas asupra Israelului a fost o „treabă din interior“. Postarea nu conținea o așa numită Notă comunitară și primise 1,2 milioane de vizualizări până la 21 noiembrie 2023.

Guvernele și organizațiile nonprofit nu sunt scutite

Dintre cele 200 de anunțuri identificate de NewsGuard în postările de tip „superspreader“ care conțineau dezinformări legate de război, 26 erau pentru organizații afiliate la guverne, inclusiv agenții guvernamentale, întreprinderi de stat și instituții media străine de stat.

De exemplu, NewsGuard a găsit o reclamă pentru FBI pe o postare din 9 noiembrie a lui Jackson Hinkle, care susținea că o înregistrare video arăta un elicopter militar israelian care trăgea asupra propriilor cetățeni. Postarea nu conținea o Notă comunitară și fusese vizualizată de peste 1,7 milioane de ori până la data de 20 noiembrie 2023.

„ISRAELUL RECUNOAȘTE că a tras asupra propriilor CIVILI cu elicoptere de ATAC APACHE!“ a scris Hinkle într-o postare care face legătura cu videoclipul. De fapt, videoclipul arăta avioane ale Forțelor Aeriene israeliene care efectuau atacuri împotriva Hamas deasupra Fâșiei Gaza, potrivit GeoConfirmed, un grup de investigatori de informații din surse deschise.

Community Notes sunt menite să semnaleze afirmațiile false, însă prea des tweet-urile virale care conțin dezinformări nu au aceste alerte

Anunțul pentru FBI care a apărut sub tweet-ul lui Hinkle a promovat activitatea agenției americane pentru a opri crimele motivate de ură. „Infracțiunile motivate de ură nu numai că fac rău victimelor, dar provoacă teamă în comunitățile lor“, se arată în anunț. „#FBI se angajează să combată infracțiunile motivate de ură și să caute dreptate pentru victime“.

NewsGuard a trimis două mesaje de e-mail și unul prin formularul de contact către FBI pe 20 noiembrie 2023, întrebând dacă anunțul a fost plasat intenționat.

Ca răspuns, un purtător de cuvânt al FBI a refuzat să comenteze și a trimis NewsGuard către X pentru întrebări despre plasarea de anunțuri pe platformă. Printre alte anunțuri de la entități guvernamentale se numără unul al companiei de stat Abu Dhabi National Oil sub un tweet care pretindea în mod nefondat că arată un blogger palestinian care simulează răni provocate de război; un anunț al Ministerului Culturii din Taiwan sub o postare care pretindea în mod fals că o înregistrare video arată militari ai Israelul trăgând asupra propriilor civili; și un anunț al China Global Television Network (CGTN) - un post de televiziune deținut de guvernul chinez - sub o postare a lui Matt Wallace care sugera că 11 septembrie 2001 a fost un „atac sub steag fals din partea guvernului israelian“. Niciuna dintre aceste postări nu a prezentat Community Notes.

Jack Brewster este editor al NewsGuard, iar Coalter Palmer și Nikita Vashisth sunt analiști. Au contribuit la acest articol Natalie Adams, John Gregory, Sam Howard, McKenzie Sadeghi și Roberta Schmid.